RAGとは ─ ChatGPTも“自分で調べて答える”時代へ進化した理由

はじめに:AIが生み出す「もっともらしい間違い」

「ChatGPTに仕事の質問をしたら、一見もっともらしい答えが返ってきたけれど、実はまったくの誤情報だった」──そんな経験はありませんか?

いま、多くの人が感じているのが、AIの“自信満々な誤回答”、いわゆるハルシネーション(幻覚)です。AIが事実ではない情報を、あたかも正しいかのように語ってしまう現象。これはAIが「嘘をついている」のではなく、知らないことを推測で補っているために起こります。

生成AIの根幹には、大量のテキストデータから言葉のパターンを学ぶ「大規模言語モデル(LLM)」があります。しかし、この学習データはあくまで過去の公開情報。つまり、AIは企業の内部文書や、学習時点以降の出来事を知らないのです。

たとえばChatGPT(GPT-5)は2025年6月までの情報を学習していますが、それ以降の出来事や社内ルール変更には対応できません。結果として、AIは「それらしい答え」を作り出してしまうのです。

こうした課題を解決する仕組みとして、近年注目を集めているのがRAG(Retrieval-Augmented Generation/検索拡張生成)です。RAGは、AIが「自分で調べてから答える」能力を持つ仕組み。いま、この技術がAIを“より信頼できる存在”へと進化させています。

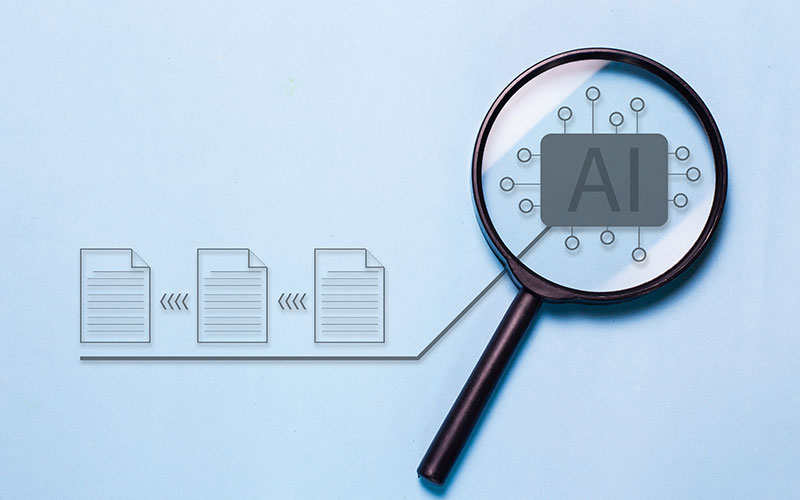

RAGとは?─AIが“調べてから話す”仕組み

RAGとは、生成AIが回答を作る際に外部の情報を検索して活用する技術のこと。

その名の通り、Retrieval(検索)とGeneration(生成)を組み合わせた仕組みです。

通常のAIは、学習済みデータをもとに答えを“予測”します。一方RAGでは、質問を受けたAIがまず関連情報をデータベースや文書から検索し、その内容を理解してから回答を生成します。まるで「資料を調べてから説明してくれるAI」と言えるでしょう。

この“検索してから答える”二段構えにより、AIは自分の知識にない情報も扱えるようになります。たとえば、従来のChatGPTが固定された知識しか持たなかったのに対し、RAGを活用すれば最新のWeb情報や社内文書を引用して答えることが可能になります。

AIが学習データの外にある情報を動的に参照できるようになった──それがRAGの革命的な点です。

なぜRAGが注目されるのか─“ハルシネーション”を防ぐ現実解

RAGが注目を集める最大の理由は、ハルシネーション(誤情報)問題への現実的な解決策だからです。

AIは知らない質問をされると、あたかも知っているかのように答えようとします。たとえば「自社の有給休暇の繰越ルールは?」と聞いても、AIは社内規定を知らないため、一般論をもとに“それっぽい答え”を生成してしまう。このときRAGを使えば、AIは社内の就業規則や人事マニュアルを検索し、該当する条文を参照して回答できます。「第4章第3条に『繰越は最大5日まで』と定められています」といった根拠つきの回答が可能になるのです。

AIの“知ったかぶり”を抑えること。そして、回答の裏付けを明示できること。この2つの特性によって、RAGは生成AIの信頼性を大きく引き上げています。

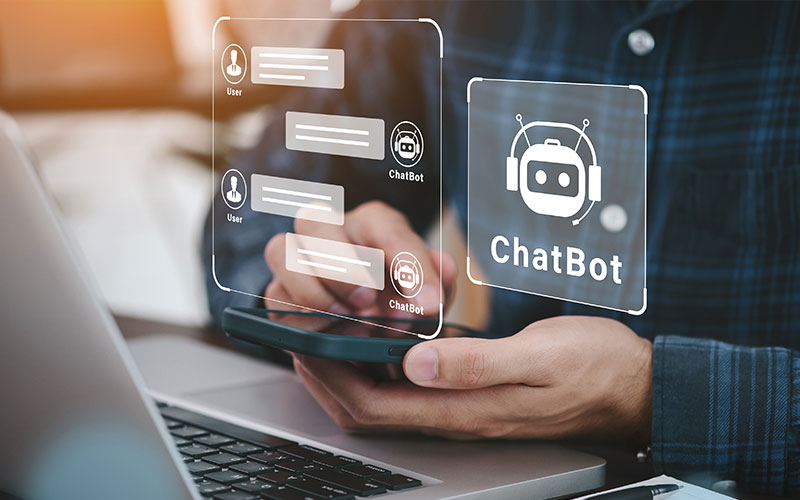

ビジネス現場での活用例─“AIが社内を調べて答える”

RAGの真価が発揮されるのは、ビジネスの現場です。

想像してみてください。社内ポータルにAIチャットボットがあり、社員が「リモート勤務の申請期限は?」と聞く。AIは就業規則データベースを検索し、「第4章第3条に『前営業日までに申請』と記載があります」と答える。さらに「関連する社内フォームを開きますか?」と案内までしてくれる。

このようにRAGを組み込めば、“AIが社内を検索して答える”という自然な業務体験が生まれます。マニュアルを探したり、人に聞いたりする時間が減り、社内ナレッジが即座に活かされる。実際に理化学研究所では、スーパーコンピュータ「富岳」の膨大なマニュアルをRAGで検索できる仕組みを導入し、問い合わせ対応時間を4時間から5秒に短縮した例もあります。

RAGは「探す時間を減らし、考える時間を増やす」ための基盤なのです。

主要AIにも広がるRAG構造─“検索して答える”が標準に

もはやRAGは専門技術ではなく、主要AIの標準機能になりつつあります。

私たちが普段使っているサービスの多くに、すでにこの仕組みが取り入れられています。

ChatGPT(GPT-5)

ChatGPTは2024年以降、ウェブ検索機能を統合し、最新のニュースや資料をリアルタイムに参照できるようになりました。「今年のノーベル賞受賞者は?」と尋ねると、AIが自らウェブを検索し、出典つきで回答します。まさに「自分で調べて答えるAI」の代表例です。

Microsoft Copilot

CopilotはWordやOutlook、TeamsなどMicrosoft 365全体に統合された生成AIで、RAG構造の典型です。SharePointやOneDrive、Outlookのメールや会議メモを横断的に検索し、そこから関連情報を抽出して回答します。社内文書・議事録・過去メールといった“あなたの職場の知識”を、AIが自在に使いこなす仕組みです。

Google NotebookLM

NotebookLMは、ユーザー自身のGoogleドキュメントやPDF、Web記事を読み込み、その内容をもとに質問に答える「パーソナルRAG環境」です。自分の資料を読んで要約してくれる──まさにAIがあなた専属のリサーチャーになる体験です。

これらのAIが共通して持つ特徴は、「記憶していることだけでなく、調べたうえで答える」という点です。RAGはもはや研究室の技術ではなく、日常に溶け込んだ新しいAIの標準構造なのです。

おわりに:AIが“自分で調べて答える”世界へ

RAG(検索拡張生成)は、生成AIが抱えていた「もっともらしい誤情報」という課題を乗り越え、AIを“信頼できるパートナー”へと導いた技術です。

AIが自ら情報を探し、根拠を示して答える。その変化は、私たちの「知る」という行為そのものを変えようとしています。

これまで「AIは間違えるもの」と思っていた人も、近い将来、「AIは調べてから答えてくれるもの」と感じるようになるでしょう。

そしてその未来は、もう始まっています。

株式会社エクセレントケアシステム 執行役員 / 情報システム部 部長(CTO)

システム開発や技術戦略の立案を担うCTOとして、2024年より現職。25年以上のエンジニア経験に加え、ITコンサルタントとして公共・医療・製造・介護分野の業務改善プロジェクトに多数携わる。 また、過去にはソフトウェア企業の取締役として事業推進を担い、経営視点を踏まえたシステム導入やDX推進に強みを持つ。現場と経営の両面から、持続可能な技術基盤の構築に取り組んでいる。